Considerando la toma de Ciudad Universitaria, suspendemos la clase de hoy. Nos vemos la semana próxima. Revisen la página de todas formas en las próximas horas, solo por si hay alguna noticia de último momento.

Autor: Pablo Daniel Mininni

-

¡Criticalpalooza!

Llegó el festival anual psicodélico de la criticalidad en la física y en áreas afines, cada año actualizado con papers más y más recientes. Tenemos entradas para ver ejemplos de fenómenos críticos en física de materiales, sistemas biológicos, fluidos, cosmología, y hasta en neurociencias. Pero comencemos con la banda número uno del lineup: Ising y su modelo.

En ausencia de campo magnético externo y cerca de la temperatura crítica (Tc), el modelo de Ising en dos dimensiones se vuelve auto-semejante. En otras palabras, a esa temperatura la presencia de islas de diferentes tamaños vuelve al sistema invariante de escala. Esto está muy bien ilustrado en el siguiente video, que muestra un estado del modelo de Ising con 1,7×1010 espines cerca de Tc. Al principio el video muestra lo que parecen ser cuatro realizaciones independientes del modelo de Ising, pero en realidad son partes más chicas de la simulación completa:

En clase vimos que este sistema tiene exponentes críticos en T cercana a Tc, y también que en esa temperatura la longitud de correlación diverge. ¡Espero que este video les aclare por qué!

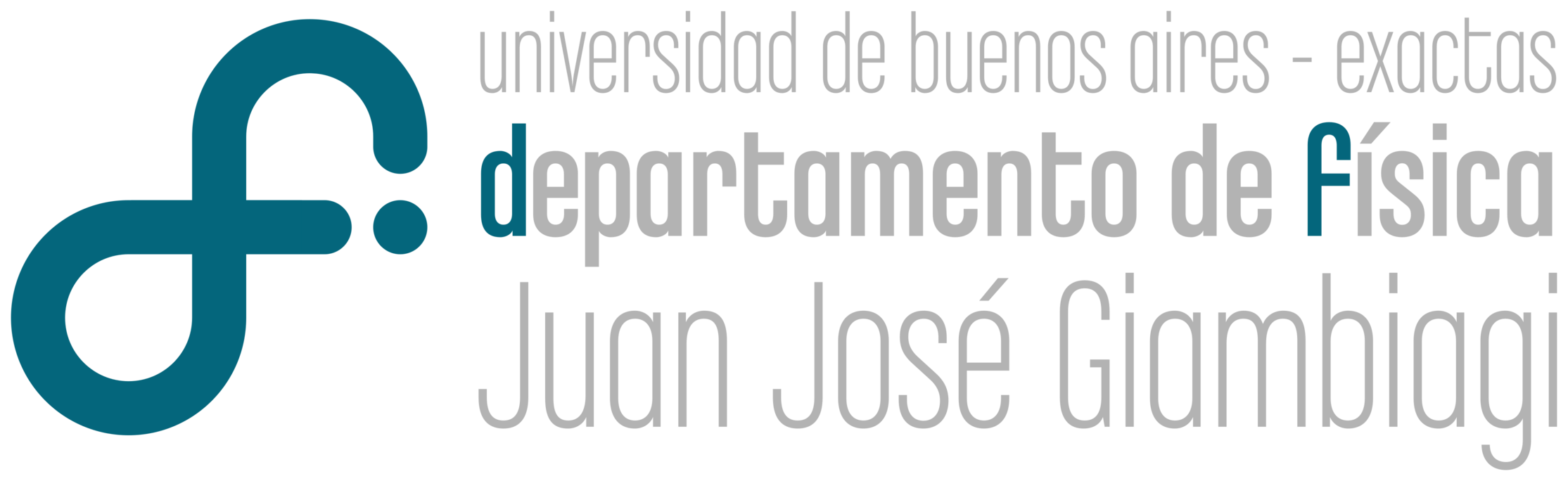

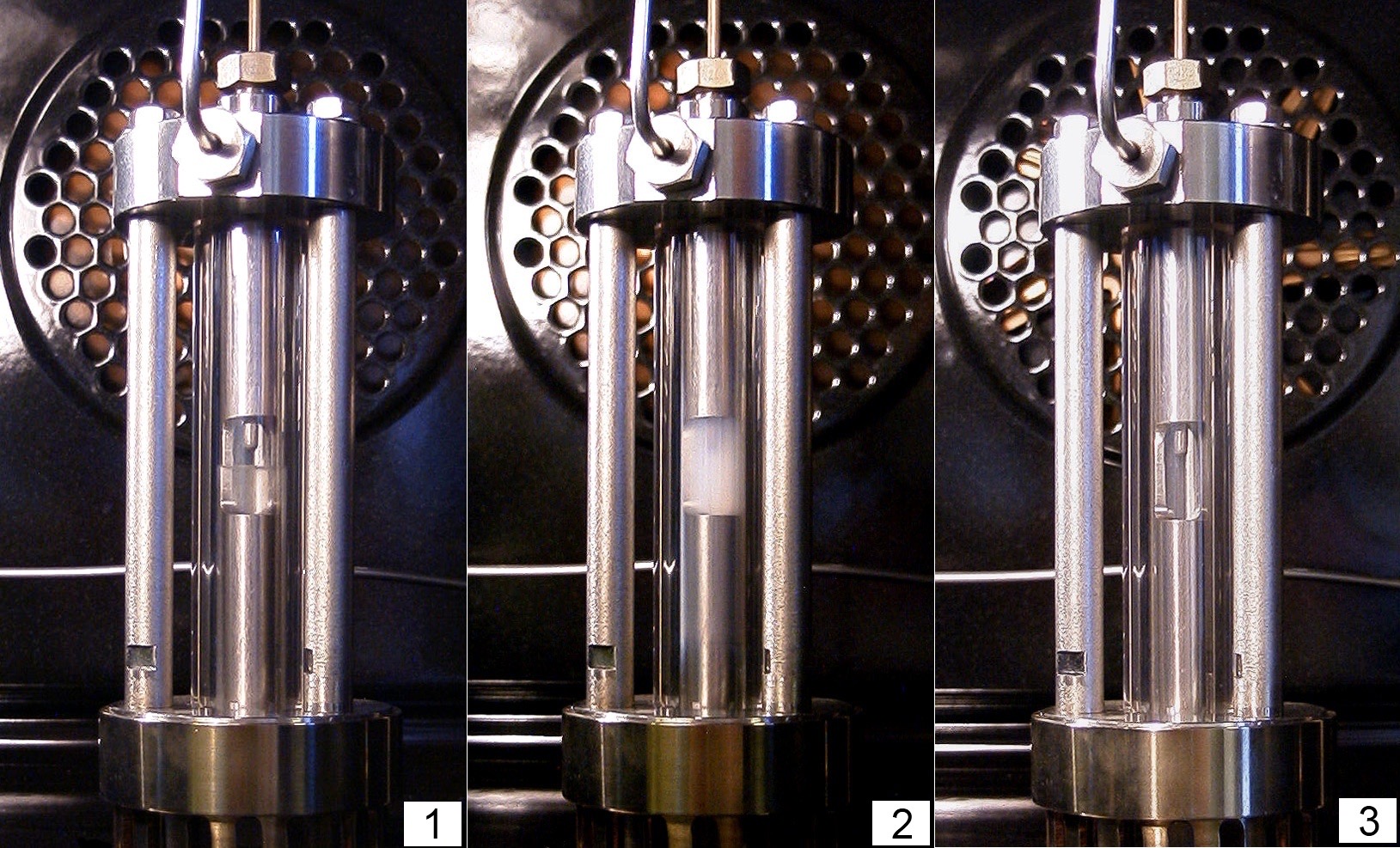

En otro escenario tenemos, junto con Guns N’ Roses, a dos ejemplos de física de materiales y materia condensada. Ya conocemos las transiciones de fase asociadas a los cambios de estado de la materia (sólido, líquido y gaseoso). ¡Pero existen muchos más cambios de fase! Así que veamos el show de bandas menos conocidas (los links los llevan a ejemplos recientes de publicaciones). Primero tenemos a los cristales líquidos. Los cristales líquidos están formados por moleculas anisótropas (generalmente alargadas, por ejemplo, con forma de largos cilindros), que se comportan con propiedades intermedias entre los líquidos y los sólidos de acuerdo a en que dirección del material se aplican los esfuerzos. Y tienen al menos dos fases: en la fase nemática (a mayor temperatura) las moléculas están más desordenadas, pero se alinean a lo largo de sus ejes principales. En cambio, en la fase esméctica (a menor temperatura) las moléculas se acomodan en capas más ordenadas, y dentro de cada capa las moléculas están inclinadas con el mismo ángulo. El cambio entre ambas fases es una transición de fase con propiedades críticas. Los interesados pueden mirar un paper reciente (Gim, Beller & Yoon, Nat. Commun. 8, 15453, 2017), donde encontrarán esta figura alucinante con cambios morfológicos del material durante la transición (para temperatura creciente, de izquierda a derecha):

Los que quieran leer otro ejemplo de transiciones de fase en física de materiales pueden mirar este artículo sobre transiciones sólido-sólido que ocurren por cambios en la forma de partículas coloidales.

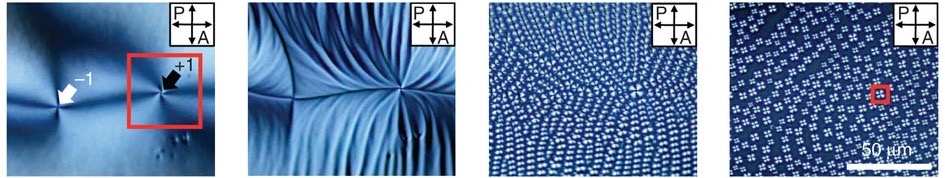

Vayamos a otro escenario del Criticalpalooza, y mientras escuchamos The Flaming Lips, veamos ejemplos recientes de transiciones de fase y autosemejanza observados en sistemas biológicos. Ciertas células cambian sus patrones de movimiento de acuerdo a la densidad de células en su entorno. A baja densidad muestran un movimiento desordenado, mientras que a alta densidad muestran patrones de movimiento colectivo y ordenado. La transición entre ambos comportamientos ocurre como una transición de fase. Pueden ver un ejemplo en Szabó et al., Phys. Rev. E 74, 061908 (2006) (el preprint está diponible en este link). La siguiente figura, de ese paper, muestra los patrones de movilidad al aumental la densidad de las células (de izquierda a derecha). Noten el cambio en el orden del sistema:

Los que tengan interés por ver más aplicaciones en biofísica, pueden mirar también un paper sobre fenómenos críticos en membranas lípidas (¡donde estiman exponentes críticos!).

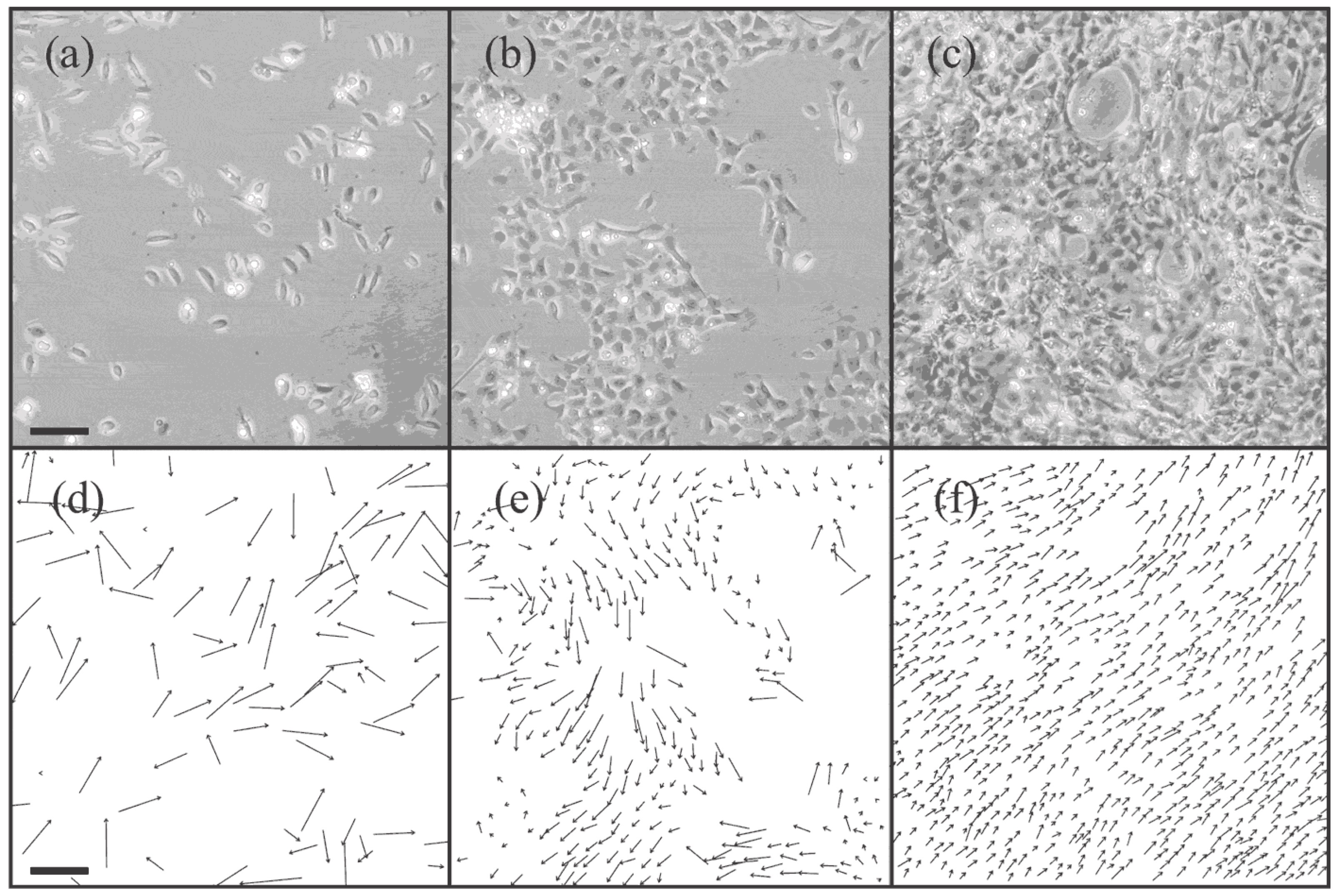

En el mismo escenario donde toca Metallica tenemos una variedad de fenómenos autosemejantes que se observan en fluidos. El más conocido es el fenómeno de la turbulencia. Los fluidos más viscosos (donde la viscosidad se mide con un número adimensional, el número de Reynolds) fluyen en forma ordenada y laminar. Pero al aumentar el número de Reynolds (y reducirse la importancia de la viscosidad), generan flujos muy desordenados que tienen propiedades de invariancia de escala. En la siguiente figura, noten como zooms sucesivos en el flujo parecen repetir los patrones (algo similar a lo que vimos en el modelo de Ising en 2D):

Esta es una transición extraña, porque los flujos turbulentos tienen propiedades de criticalidad y autosemejanza, pero son un sistema fuera del equilibrio. Pueden ver más imágenes de flujos turbulentos aquí. Y pueden ver un ejemplo de una transición de fase en turbulencia en un condensado de Bose-Einstein en este paper.

Los que tengan interés por cosmología pueden ir al escenario donde tocan Empire of the Sun y Lee Smolin, y leer este artículo donde se discuten diversos problemas (como la formación de galaxias espirales, la estructura de gran escala del universo, o el universo temprano) desde el punto de vista de fenómenos críticos. También en cosmología, algunas teorías predicen que una transición de fase podría haber ocurrido en el universo temprano, cuando se formaron los primeros átomos. Luego de ese momento el universo se volvió transparente, pero antes de ese instante el universo puede haber sido opalescente en forma crítica (como la mezcla de un líquido y un gas cuando llega a la temperatura crítica y dejan de existir las diferencias entre ambas fases, como se ve en la foto del centro en esta imágen de una mezcla de etano líquido y gaseoso tomada de Wikipedia):

Ya que estamos en el festival, no nos olvidemos de ir a ver las bandas clásicas. El mecanismo de Higgs por el cual los bosones de gauge adquieren masa, es también un mecanismo de ruptura espontánea de la simetría.

Para cerrar el festival, este Criticalpalooza no tendrá a The Strokes, pero tiene ejemplos de fenómenos críticos en el cerebro. Las funciones cognitivas involucran procesos que van desde las neuronas individuales hasta regiones grandes del cerebro, y en los últimos años se encontró evidencia creciente de que el cerebro funciona en el borde entre el orden y el desorden, con propiedades de fenómenos críticos. Los interesados en ver ejemplos de criticalidad y autosemejanza en el cerebro pueden mirar este paper o este paper. O, si quieren mirar dos papers más recientes, pueden ver este paper publicado en Science Advances o este paper escrito por varios investigadores del Departamento de Física. Ambos tienen gráficos que muestran cómo se calculan los exponentes críticos en este sistema. La siguiente imagen, tomada de Cochi et al., Progress in Neurobiology 158, 132 (2017) (el primero de los cuatro papers) es bastante sugerente:

-

Deus ex machina

Ex Machina (disponible en Netflix) es una película de 2014 con algunos giros de tuerca inquietantes alrededor de la idea de construir máquinas con inteligencia artificial. Sorprendentemente, o no tanto, los temas de esta materia tienen una relación cercana con este problema. El premio Nobel de Física 2021 fue otorgado a Giorgio Parisi, Syukuro Manabe y Klaus Hasselmann por contribuciones fundamentales a la comprensión de los sistemas complejos. Y en particular, la mitad del premio Nobel fue para Giorgio Parisi, entre otras cosas, por sus aportes al estudio de los vidrios de spin. Los vidrios de spin son un modelo sencillo para sistemas magnéticos amorfos, un caso en cierto sentido más general que el de los modelos de Ising que estamos considerando en el curso. Más recientemente, el premio Nobel de Física 2024 fue para John Hopfield y Geoffrey Hinton, por descubrimientos fundamentales que permitieron el aprendizaje automático con redes neuronales. Hinton usó herramientas de mecánica estadística para inventar la máquina de Boltzmann, una red neuronal útil para clasificar y crear imágenes. Y Hopfield es un físico que trabajó en materia condensada y luego en neurociencias, y que creó una red neuronal que lleva su nombre.

Ustedes podrán preguntarse qué relación hay entre mecánica estadística, el modelo de Ising, vidrios de spin, e inteligencia artificial. Comencemos por un problema más sencillo (o tal vez mucho más difícil): el juego de Go. El Go es un juego de mesa, pariente del ajedrez, en el que dos jugadores ponen piedras blancas o negras en turnos, en cualquier lugar del tablero, en una cuadrícula de 19×19 puntos. El objetivo del juego es rodear la mayor cantidad de territorio posible con las piedras del color del jugador.

Las reglas son muy sencillas: (1) Una piedra sin libertades (es decir, completamente rodeada por piedras del color opuesto) es capturada y removida del tablero. (2) No se pueden hacer jugadas que recreen la situación previa del tablero. Y (3) cuando un jugador pasa su turno dos veces seguidas, el juego termina. A pesar de esta simpleza (o tal vez como resultado de la misma), es un juego muy complejo. El número de posiciones legales en el tablero es mayor a 10170 , muchísimo más grande que en el ajedrez, y más grande que el número de átomos en el universo. Como resultado, los métodos para hacer que computadoras jueguen al Go calculando todas las jugadas posibles (como se hace con el juego de ajedrez) son inviables. Así, el juego de Go resultaba un desafío más que interesante para la inteligencia artificial.

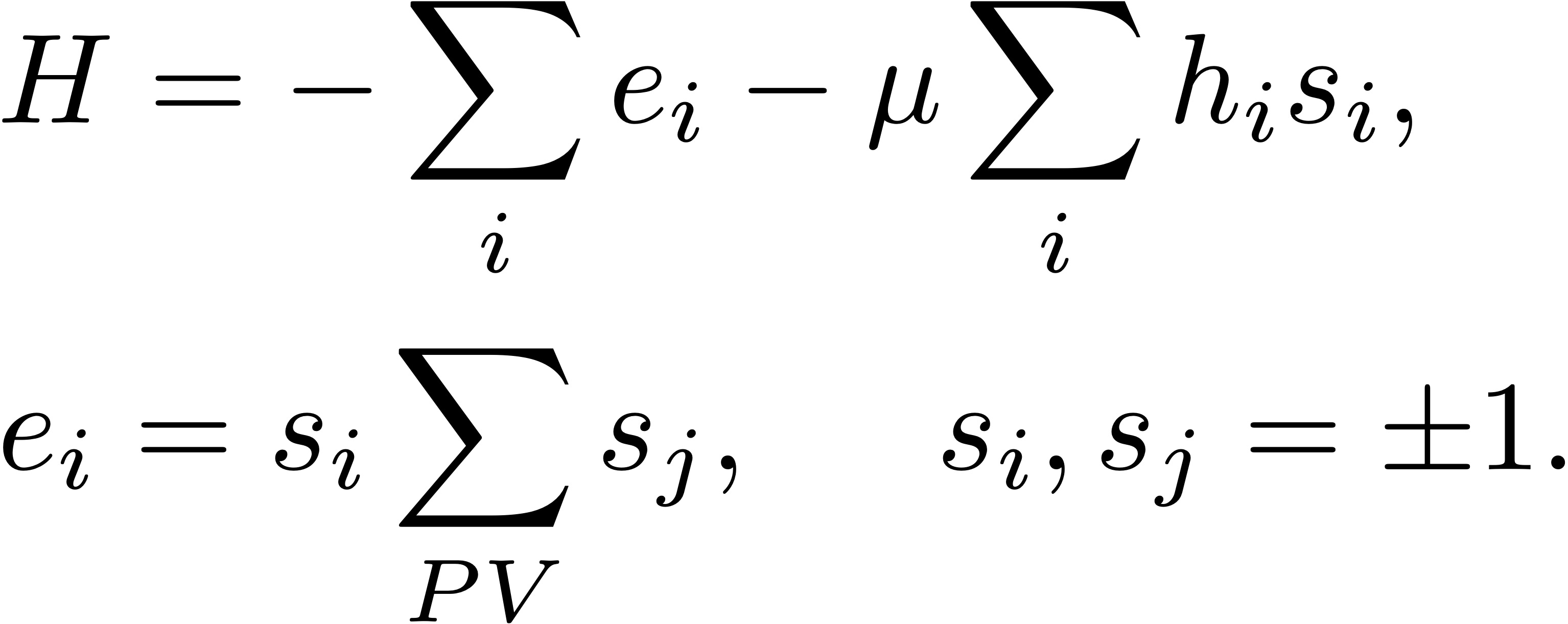

Hasta hace unos años, uno de los métodos preferidos para programar computadoras para jugar al Go era aplicar el método de Montecarlo (que usarán en la práctica computacional) para encontrar configuraciones del tablero que minimizan la energía (o el Hamiltoniano) de un modelo de Ising que tiene alguna relación con las reglas del juego de Go, y con las condiciones para ganar una partida. Por ejemplo, un posible Hamiltoniano es el siguiente, donde si es el color de las piedras en cada posición (+1 o -1 para blanco o negro), hi es el número de libertades de la piedra i-ésima (cuantos casilleros tiene libre alrededor), PV indica que la suma se hace sobre los primeros vecinos, y μ (>0) es una “energía” que premia las configuraciones en las que las piedras propias (+1) tienen libertades (es decir, no están rodeadas):

¡De pronto, el modelo de Ising encuentra aplicaciones muy lejos de la física de materiales magnéticos! Sin embargo, estos métodos resultan en programas de Go que juegan apenas tan bien como un jugador humano mediocre. Y cuando el problema de jugar bien al Go parecía inaccesible para las computadoras, Google presentó en 2016 una red neuronal profunda que le ganó a todos los grandes campeones humanos del juego.

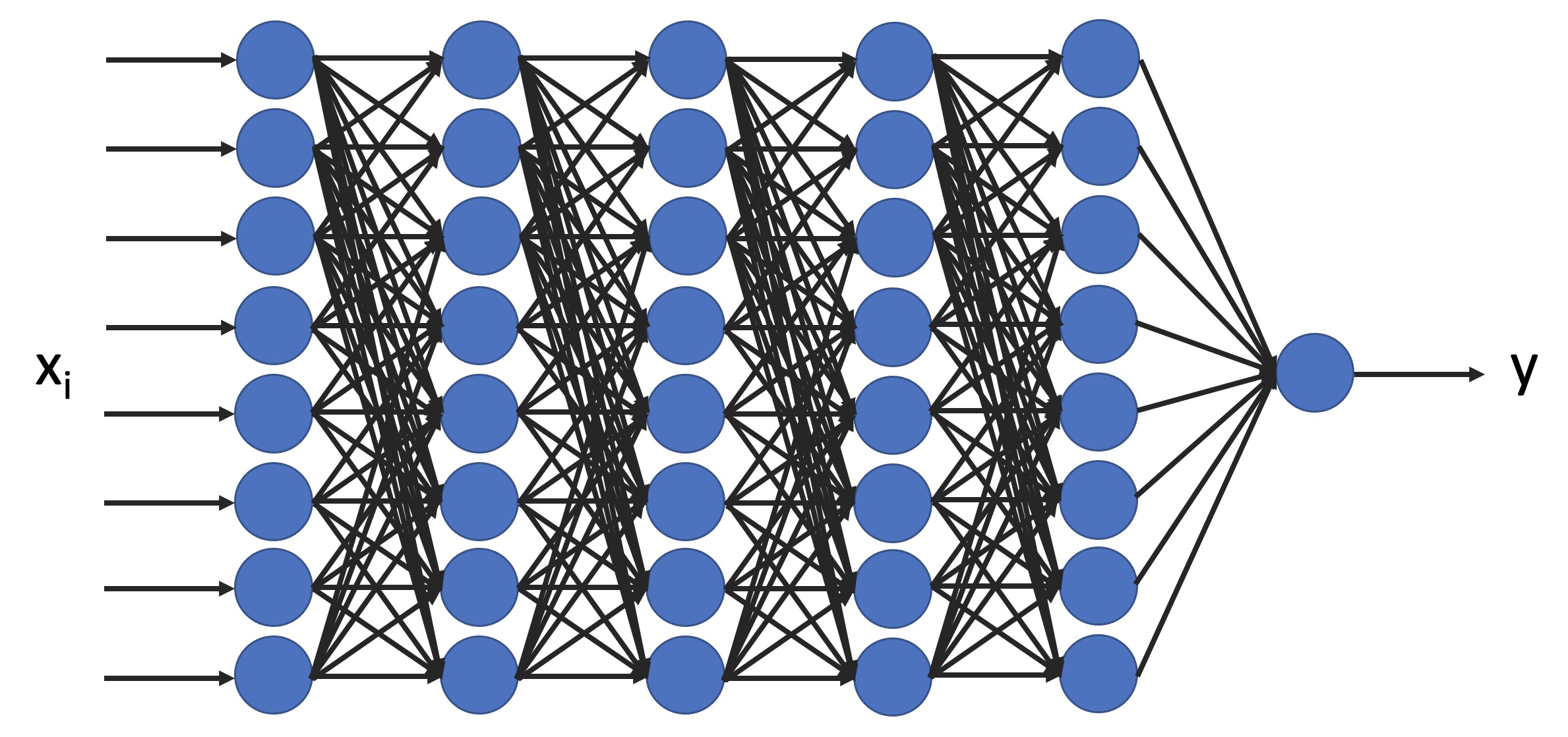

Una red neuronal profunda es una red con muchas capas de neuronas artificiales: los datos ingresan (en la siguiente figura, por la izquierda), son multiplicados por coeficientes (llamados “pesos”) en cada conexión entre neuronas, y el resultado es procesado con alguna operación sencilla por cada neurona (que puede estar “activada”, o “inactivada”). El procedimiento se repite en cada capa de neuronas, hasta que se obtiene un resultado final (por dar un ejemplo muy crudo y simplificado, ingresa el estado actual del tablero de Go y obtenemos como resultado la próxima jugada que conviene realizar):

Las redes neuronales son entrenadas con muchísimas jugadas, de forma tal de ajustar los pesos en cada una de las conexiones de las neuronas y obtener un resultado óptimo. Pero noten que la estructura de la red no es muy diferente a la de los sistemas magnéticos que estuvimos estudiando en el curso: tenemos nodos que interactúan con sus vecinos con algún coeficiente de acoplamiento, y su equilibrio corresponde al mínimo de alguna función (el error en la respuesta que obtenemos). La diferencia es que ahora esos coeficientes (los pesos) no están fijos, y pueden cambiar durante el entrenamiento.

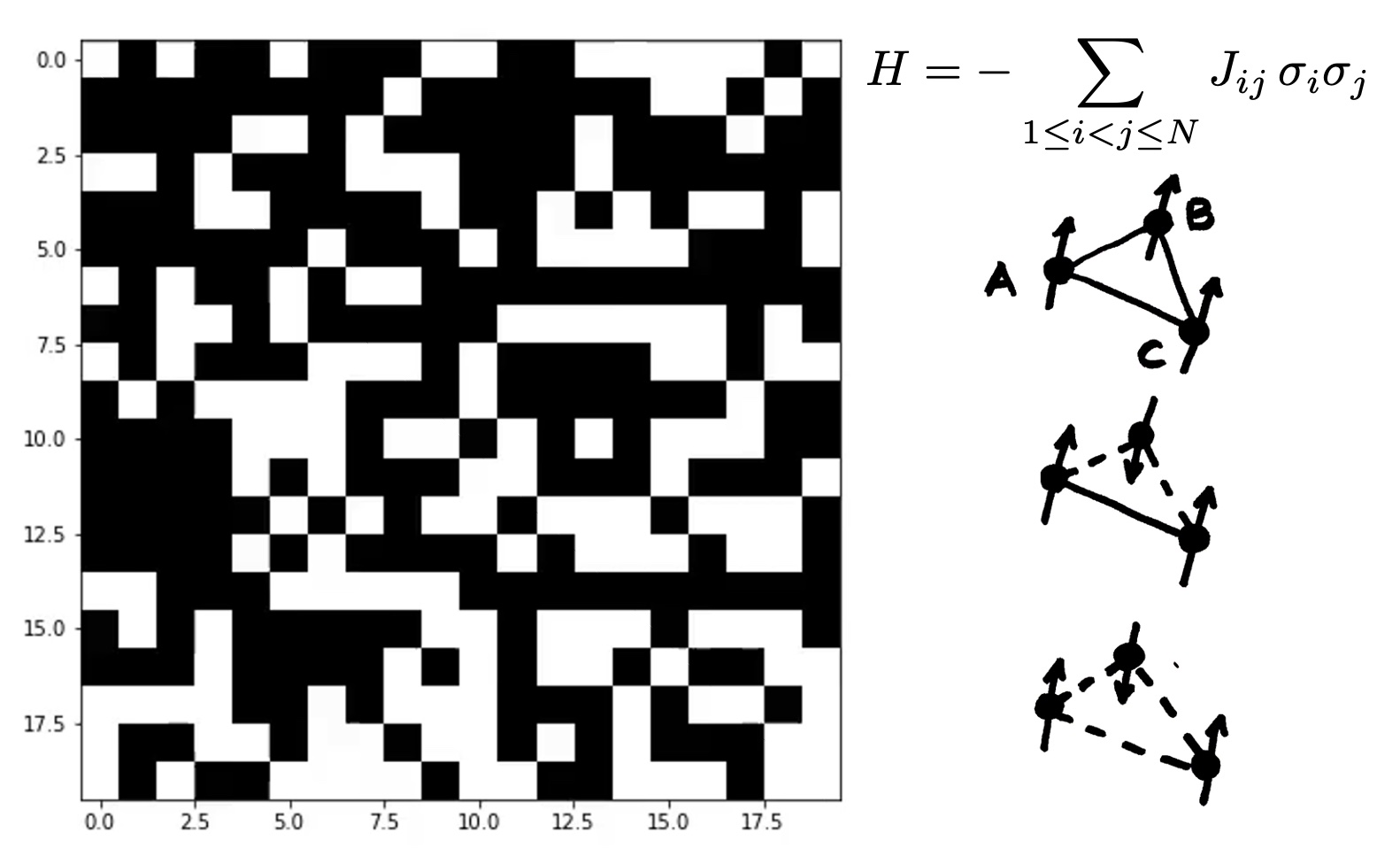

En física ocurre algo similar en materiales magnéticos amorfos. La estructura de la red de spines en esos materiales puede ser muy compleja, y los spines pueden interactuar con otros spines muy lejanos (en la peor situación posible, pueden interactuar todos contra todos). Y los spines pueden tener coeficientes de acoplamiento diferentes para cada par, que en la siguiente figura se indican en el Hamiltoniano como Jij para el acomplamiento del par ( i, j ). La variante de los modelos de Ising que se usa para estudiar este tipo de sistemas es conocida como vidrios de spin:

Los vidrios de spin son formalmente equivalentes a un tipo particular de redes neuronales (¡las redes de Hopfield!), pero además, muchos de los resultados que se obtuvieron para vidrios de spin se trasladan a la teoría de redes neuronales en forma más general. Al construir la mecánica estadística de estos sistemas, la dificultad radica en que no solo es necesario armar ensambles con copias de todos los alineamientos posibles de los spines, sino que también es necesario armar réplicas del sistema con diferentes acoplamientos Jij (ya que uno no sabe cuánto valdrán los pesos de cada neurona, o los acoplamientos de los spines). Parisi hizo contribuciones muy relevantes que permitieron atacar este problema, y entender propiedades generales de los estados de equilibrio. Y Hopfield, obviamente, inventó la red neurnal equivalente a estos sistemas que hoy lleva su nombre.

Los vidrios de spin y las redes de Hopfield, dada su complejidad, no tienen un único equilibrio: tienen una variedad muy grande de equilibrios posibles, que corresponden a mínimos locales de su energía libre. Así, la mecánica estadística de los vidrios de spin también nos da información sobre a qué estados posibles puede decaer una red neuronal durante el aprendizaje, o nos permite saber que ciertas redes neuronales pueden guardar “recuerdos”, y calcular la máxima cantidad de información que puede almacenarse en esas redes en función de su estructura, del número de neuronas, y del número de conexiones entre neuronas. Así que en la próxima fiesta en la que alguien les diga que el premio Nobel 2024 no era de física, pueden contarle todo esto.

-

Síndrome del fluido normal

“¡Todos pueden ser súper! ¡Y cuando todos sean súper, nadie lo será!” La película Los increíbles (2004) tiene a uno de los villanos más interesantes de las películas de superhéroes. Syndrome no busca dominar al mundo, no desea poder o dinero. Desea que todos sean iguales, y que los superhéroes dejen de ser especiales. Los condensados de Bose-Einstein son súper, y están asociados a muchos fenómenos súper como la superconductividad y la superfluidez. Así que tal como prometí ayer en el aula, acá dejo un posteo largo con varios videos y fuentes sobre el tema para los que quieran seguir leyendo.

Empecemos con un video sobre condensados de Bose-Einstein atómicos . Como mencioné en clase, recién en 1995 se realizaron los primeros experimentos de condensados de Bose-Einstein en gases diluídos de átomos ultrafríos, en los que la interacción entre los átomos es débil:El video muestra un experimento con un gas de átomos de sodio. La descripción del experimento ocurre entre el minuto 0:46 hasta 2:50. A partir del minuto 3:10 hasta 3:50 pueden ver mediciones de la temperatura en el gas, y la formación del condensado de Bose-Einstein.

Los que tengan un poco mas de paciencia pueden ver la charla completa de Eric Cornell cuando recibió, junto con Carl Wieman y Wolfgang Ketterle, el premio Nobel por conseguir el primer condensado de Bose-Einstein gaseoso en el laboratorio:

El video dura 39 minutos. Los que quieran pueden saltear la introducción e ir al minuto 5:23 hasta 7:03, donde Cornell explica el rol que juega la longitud de onda de de Broglie en la transición de fase (algo que vimos en el curso). Y a partir del minuto 28:49, Cornell muestra imagenes de vórtices cuantizados, un tema que generó muchas preguntas en la última clase.

Respecto a cómo se ve un superfluido en el laboratorio, el siguiente video, muy corto (1:44 minutos) pero muy recomendable, muestra varias de las propiedades más llamativas de los superfluidos, como la capacidad de trepar por las paredes de un recipiente, o el “efecto fuente”:

Luego pueden ver un video mas reciente (en castellano) con experimentos de vórtices cuantizados en He-4 superfluido. Como vimos en el aula, el hecho de que los bosones que forman el superfluido sean indistinguibles, hace que los vórtices en el flujo no puedan rotar a cualquier velocidad, y que su circulación se cuantice. Las lineas blancas sobre fondo negro que se ven en los primeros 5 segundos del video son vórtices cuantizados observados en el laboratorio:

Para los que quieran leer mas sobre He-4 superfluido, les aconsejo leer el siguiente trabajo de Richard Feynman. Aunque es un poco antiguo y la interpretación actual de los rotones es diferente a la planteada en el artículo, muchas de las especulaciones que hace Feynman fueron más tarde confirmadas en experimentos:

Este trabajo tiene una historia interesante atrás. Feynman presentó, antes de escribir el artículo, sus resultados en un congreso al que asistió Lars Onsager (que era famoso en el área). Feynman estaba bastante orgulloso de si mismo (por estos resultados, pero también se encontraba en ese estado la mayor parte del tiempo), y Onsager decidió darle una lección. La narración completa la pueden encontrar en “Surely You’re Joking, Mr. Feynman!“, pero en palabras de Feynman es más o menos así:

“Bueno, Feynman”, dijo Onsager con voz ronca, “escuché que crees que has entendido el helio líquido”.

“Bueno, sí…”

“Umm…” ¡Y eso fue todo lo que me dijo durante toda la cena! No fue muy estimulante.Al día siguiente di mi charla, y expliqué todo sobre el helio líquido. Al final, mencioné que había algo que todavía no había logrado entender: si la transición entre una fase y la otra del helio líquido era de primer orden (como cuando un sólido se derrite o un líquido hierve, y la temperatura se mantiene constante) o de segundo orden (como ocurre en el magnetismo, donde la temperatura puede cambiar).

Entonces el profesor Onsager se levantó y dijo duramente: “Bueno, el profesor Feynman es nuevo en nuestra área, y creo que necesita ser educado. Hay algo que tiene que aprender y que debemos decirle”.

Pensé: “¡Oh no! ¿Qué hice mal?”

Onsager dijo: “Deberíamos decirle a Feynman que nadie ha podido obtener el orden de una transición a partir de primeros principios, por lo que el hecho de que su teoría no le permita calcular eso no significa que no haya entendido todo los otros aspectos del helio líquido satisfactoriamente”. Resultó ser un cumplido, pero por la forma en que comenzó, ¡pensé que me iba a dar una paliza! -

Chandra y las enanas blancas

Posted on mayo 21, 2024 by Pablo Daniel Mininni

“There’s a starman waiting in the sky,

he’d like to come and meet us

but he thinks he’d blow our minds”

David Bowie, Starman (1972).“Chandra y las enanas blancas” no es el nombre de una banda de rock (¡podría serlo!). Pero el personaje principal de esta historia es el verdadero Starman, el hombre de las estrellas. Y los aportes que hizo a la física nos vuelan la mente. Esta es la historia de Subrahmanyan Chandrasekhar y un tipo muy particular de estrellas. Chandrasekhar ganó el premio Nobel en 1983 por sus estudios sobre la evolución y la estructura de las estrellas, pero su camino hasta ese premio no fue fácil. El Dr. Chandra, un personaje en 2001: A Space Odissey, lleva su nombre en homenaje a él.

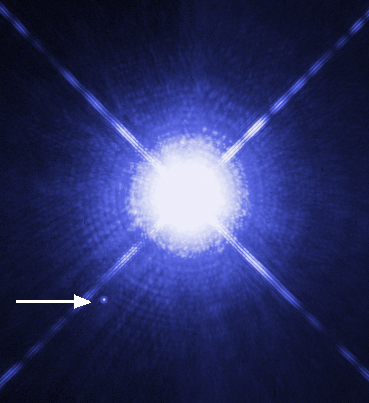

Hace un par de clases vimos que la presión de degeneración en un gas de fermiones es central para explicar la estabilidad de estrellas enanas blancas (y también juega un rol en estrellas de neutrones). Una enana blanca es una estrella que quemó todo su material nuclear: una estrella como el Sol, luego de quemar todo el hidrógeno, quema material nuclear más pesado como el Helio. Para ello necesita mayor presión y temperatura en el núcleo, pero también genera mas energía en la reacción nuclear, y se expande hasta convertirse en una gigante roja. Luego de quemar todo el material disponible para la fusión, sufre una inestabilidad y expulsa buena parte de su masa. El núcleo de la estrella, que puede tener una masa equivalente a la del Sol pero comprimirse hasta un volumen como el de la Tierra, mantiene el calor residual y forma la enana blanca. La siguiente imágen muestra a Sirius B, una enana blanca, indicada por la flecha:

Si una enana blanca no quema más material nuclear, ¿qué mantiene a la estrella estable evitando el colapso gravitatorio? La respuesta es la presión de degeneración en un gas de Fermi: en la estrella la densidad de la materia es tan grande que el gas está degenerado (es decir, las funciones de onda de las diferentes partículas se superponen), y y la presión de Fermi es suficiente para contrarrestar la fuerza de gravedad. Recuerden que la presión de radiación resulta del principio de exclusión de Pauli. Es el hecho de que dos ferminones no puedan tener los mismos números cuánticos lo que evita que la estrella colapse gravitatoriamente. Algo parecido ocurre en estrellas inicialmente aún mas masivas, que pueden evolucionar a estrellas de neutrones. Finalmente, si la masa inicial de la estrella es aún mayor (más grande que la masa límite de Chandrasekhar), la presión de degeneración no es suficiente para evitar el colapso gravitatorio y se puede formar un agujero negro.

Los que quieran leer mas detalles sobre el balance de fuerzas en una estrella enana blanca pueden ver el siguiente link (9 páginas, en inglés):

Chandrasekhar reconoció la existencia de una masa límite, por encima de la cual las estrellas podían colapsar y formar agujeros negros, muy temprano en su carrera científica. Se enfrentó a diversos prejuicios raciales en Inglaterra y en Estados Unidos. Pero, al mismo tiempo, su idea sobre la existencia de una masa límite también se adelantó a la época. Cuando Chandrasekhar formuló su idea, el conocimiento sobre interiores estelares era bastante incipiente. Y por ese motivo muchos físicos y astrónomos presentaron dudas razonables a su validez. Chandrasekhar no bajó los brazos y a lo largo de varias décadas trabajó en mecánica estadística, dinámica de fluidos, relatividad general, y otros temas hasta crear una teoría muy sólida sobre la física de las estrellas. Mientras estudiaba estos fenómenos, y muchos otros, Chandrasekhar estableció las bases de lo que hoy conocemos como la teoría de interiores estelares, y sobre cómo evolucionan las estrellas en el tiempo. Las contribuciones de Chandrasekhar al estudio de interiores estelares, la evolución de las estrellas hasta la formación de enanas blancas o agujeros negros, y sus estudios de la estadística de Fermi-Dirac para explicar la estabilidad de las enanas blancas, lo llevaron a tener diversas disputas con astrónomos renombrados de la época, como Arthur Eddington. Y también, eventualmente, a ganar el premio Nobel junto con William Fowler.

-

Eterno retorno de una configuración sin recuerdos

“Ha llegado el momento de anunciar: Esta isla, con sus edificios, es nuestro paraíso privado. He tomado algunas precauciones -físicas, morales- para su defensa: creo que lo protegerán. Aquí estaremos eternamente -aunque mañana nos vayamos- repitiendo consecutivamente los momentos de la semana y sin poder salir nunca de la conciencia que tuvimos en cada uno de ellos.“

Adolfo Bioy Casares, La invención de Morel (1940).

Para cerrar la primera mitad de los temas teóricos de la materia, voy a hacer un último comentario sobre la irreversibilidad en el tiempo en sistemas extensos. El título del posteo hace referencia a Eterno resplandor de una mente sin recuerdos, película de 2004 dirigida por Michel Gondry en base a un guión de Charlie Kaufman. Los interesados en las repeticiones pueden ver también I’m Thinking of Ending Things en Netflix (dirigida por Charlie Kaufman), y Memento o Tenet (estas dos últimas dirigidas por Christopher Nolan). También pueden leer “La invención de Morel” de Adolfo Bioy Casares. Pero sepan que la repetición eterna, como los espejos y la cópula para un heresiarca de Uqbar, es abominable (excepto tal vez para Friedrich Nietzsche). Probablemente nos parezca antinatural justamente porque nunca observamos en la naturaleza que las configuraciones de sistemas extensos se repitan exactamente de la misma forma. Esta observación fue una de críticas que Poincaré y Zermelo, entre otros, realizaron a la teoría estadística de Boltzmann. Imagino que Sísifo también tendría sus objeciones. Y a Dormammu tampoco le deben gustar las repeticiones:

En el teorema H de Boltzmann, su entropía casi siempre crece. Imaginemos un gas que ocupa la mitad de un recinto, separado en dos por un tabique. En un dado instante el tabique se retira, y el gas se expande hasta ocupar todo el recinto (con el consecuente aumento de la entropía). Esta expansión es irreversible. Pero como todas las configuraciones son equiprobables, en algún instante todas las moleculas del gas podrían estar nuevamente en la primera mitad del recinto. Y si en ese preciso instante volvemos a poner el tabique, recuperamos en forma espontánea la primera configuración, que tenía menor entropía. Este posible retorno a una configuración previa fue visto por Poincaré como un problema abominable para la teoría de Boltzmann (aunque más tarde Poincaré se convenció del valor de la teoría y se retractó).

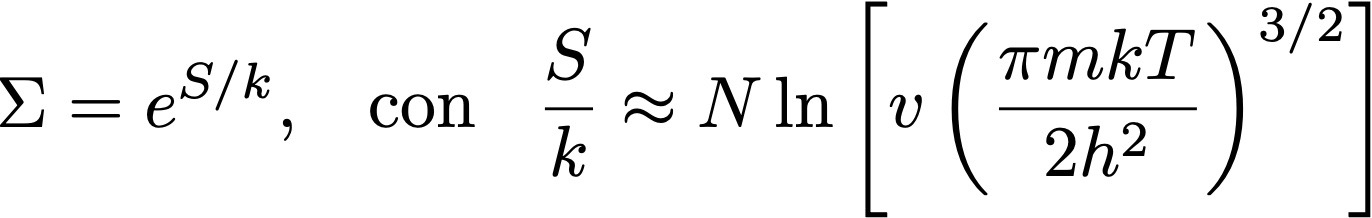

Efectivamente, si el número de configuraciones de un gas es discreto, existe una probabilidad no nula de que vuelva espontáneamente a una configuración previa (o, si las configuraciones son contínuas, de que vuelva a una configuración arbitrariamente cercana a la configuración inicial). Pero el tiempo necesario para volver a encontrar esta configuración es increíblemente largo, lo que vuelve a este escenario irrelevante a fines prácticos. Estimemos esto para un metro cúbico de aire a temperatura ambiente (T = 300 K). Vimos que el número de configuraciones Σ de un gas ideal lo podemos calcular, en el ensamble microcanónico, como

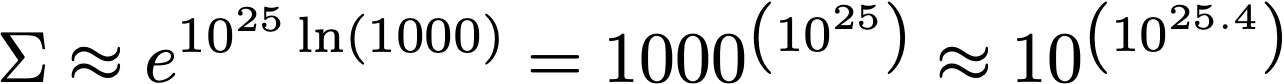

donde S es la entropía, N el número de partículas, v el volúmen específico del gas, m la masa de las partículas (mayormente moléculas de N2), k la constante de Boltzmann, y h la constante de Planck (ignoro un factor aditivo despreciable en la entropía). Usando valores típicos para estos parámetros (y considerando que v ≈ 5 x 10-29 m3), obtenemos que el número de microestados o configuraciones posibles es

¡Este es un número enorme, con más de 1025 dígitos! Asumamos ahora que las configuraciones cambian cada vez que hay un choque entre partículas. Es decir, cuando las partículas en el gas chocan, intercambian momento, y pasan de una configuración a otra. Como vimos en clase, para el aire a temperatura y presión ambiente, el tiempo entre choques es τ ≈ 10-10 s. Y si todas las configuraciones son equiprobables, podemos estimar el tiempo medio para repetir una configuración como proporcional a Σ·τ, que sigue siendo un número muy grande (un tiempo con más de 1025 dígitos, medido en segundos). ¡Como comparación, la edad del universo es de 4.3 x 1017 s, muchísimo más chica que el tiempo medio necesario para repetir la configuración de un gas en solo un metro cúbico! Por lo que el “casi siempre crece” de Boltzmann está bastante bien. En otras palabras, en sistemas extensos, las chances de que un sistema vuelva en forma espontánea a una configuración previa realmente es despreciable.

Hoy sabemos que aún en sistemas no tan grandes, fuera del equilibro la probabilidad de que la entropía crezca es mucho más grande que la probabilidad de que la entropía disminuya. De hecho, sabemos que la razón entre estas dos probabilidades es igual a la exponencial de la variación de la entropía por el tiempo transcurrido, un número que se vuelve exponencialmente más grande a medida que la entropía del sistema crece, o que transcurre más tiempo. En el caso general, este resultado se conoce como el teorema de fluctuación detallado. Los que quieran aprender más sobre resultados para sistemas fuera del equilibrio pueden leer también sobre el teorema de fluctuación de Crooks, la igualdad de Jarzynski, y las relaciones de Green-Kubo.

-

Materia oscura y el virial

En la clase de ayer vimos el teorema del virial. Este es un teorema muy útil, tanto en la versión de Mecánica Estadística como en su versión de Mecánica Clásica. Pero también es un teorema que puede ser fácilmente aplicado a situaciones en las que no se cumplen sus hipótesis, para darnos resultados erróneos. Recuerden que las partículas en el sistema deben estar confinadas por el potencial. A continuación les doy dos ejemplos de aplicaciones, que mencioné brevemente en clase.

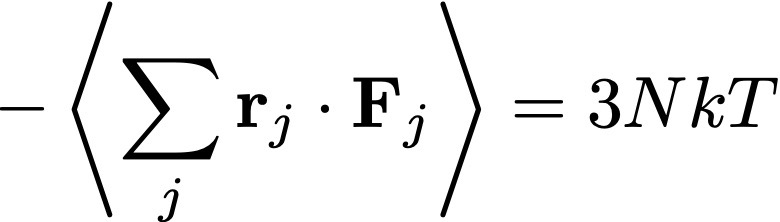

Comencemos con el gas ideal. Hemos visto que el teorema del virial puede escribirse como

donde las coordenadas r son las posiciones de las partículas, F son las fuerzas sobre cada partícula, N es el número de partículas, y T la temperatura. La suma es sobre todas las partículas. Para un gas ideal, la única fuerza que tenemos está asociada a la presión P. Usando que la fuerza total, sumada sobre todas las partículas, es ∑ r · F = – ∫ r · n P dA (donde n es la normal externa a la pared, y dA el diferencial de superficie), después de hacer algunas cuentas se puede llegar (usando el teorema de Gauss) a que el término de la izquierda es 3PV (con V el volúmen). ¡Por lo que recuperamos la ecuación de estado de un gas ideal: PV = NkT!

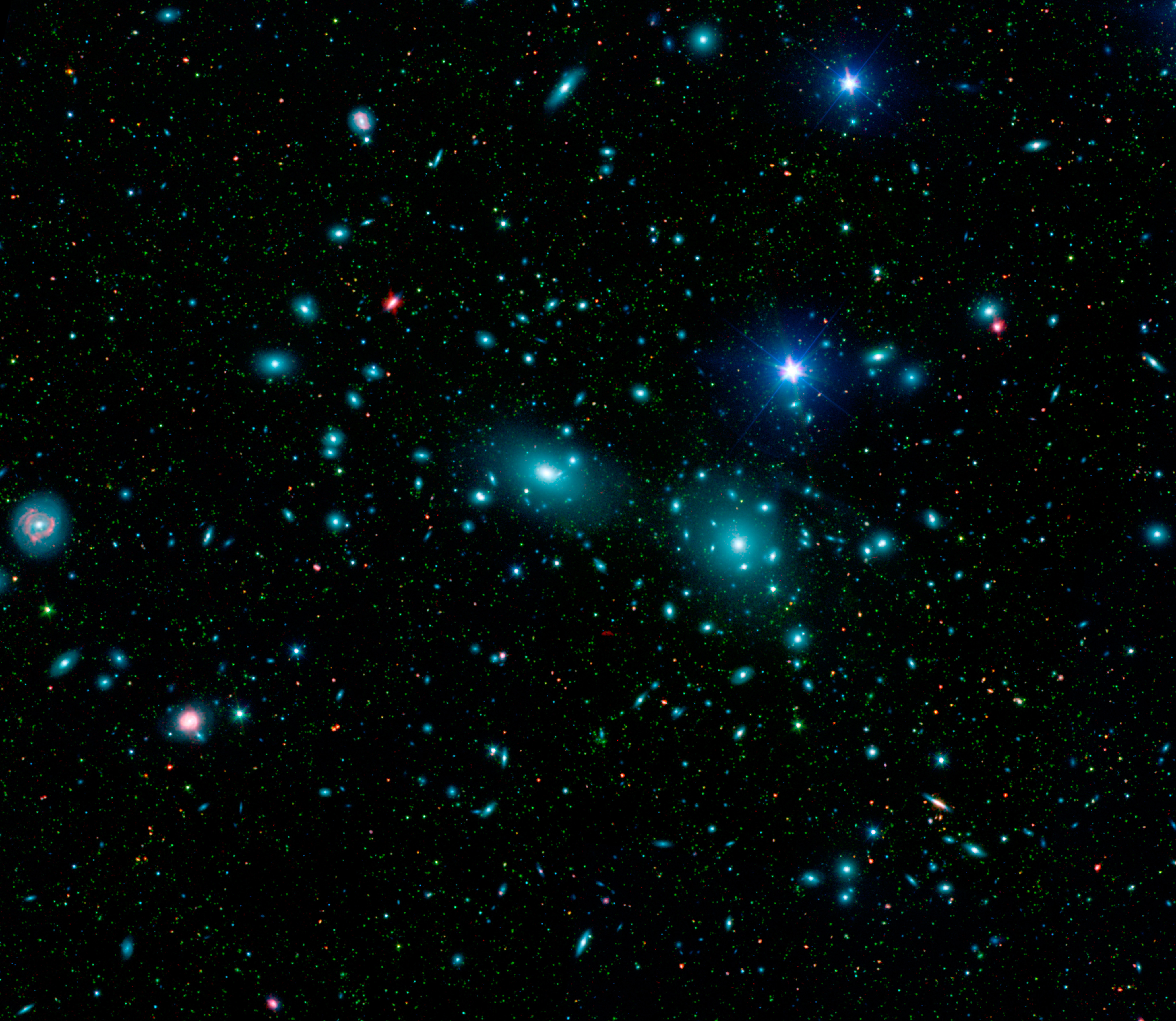

Veamos ahora una aplicación más interesante. Consideremos un clúster de N galaxias (es decir, una acumulación de galaxias en el universo), cada una con masa m y con masa total M = Nm. Por ejemplo, podría ser el cúmulo de Coma, un clúster con más de 1000 galaxias identificadas a 321 millones de años luz de la Tierra:

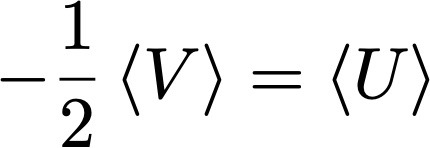

Las galaxias en el clúster están confinadas por la fuerza gravitatoria. Nos conviene ahora escribir el teorema del virial, para una fuerza que decae como el cuadrado de la distancia, como

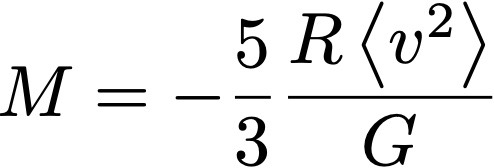

donde U es la energía cinética y V ahora es la energía potencial. Asumiendo que el clúster es esférico, para la fuerza gravitatoria V = -3GM 2/(5R), donde G es la constante de gravitación universal, y R el radio del clúster. Por otro lado la energía cinética media es <U > = M <v 2>/ 2. De estas dos relaciones podemos estimar la masa del clúster como

La velocidad cuadrática media de las galaxias en el clúster se puede medir, por ejemplo, por corrimiento Doppler. Y la masa del clúster se puede estimar de forma independiente a esta fórmula a partir de la luminosidad del clúster, usando relaciones bien calibradas en astronomía. Y aquí comienzan los problemas: la fórmula obtenida con el teorema del virial da una masa M mayor que la que se estima con la luminosidad, sugiriendo que falta una fracción de materia que no estamos observando cuando miramos la luminosidad de las galaxias. Este argumento puede ser ampliado para considerar otras formas de energía (por ejemplo, la energía en el campo magnético de las galaxias y del clúster), pero esto no cambia el resultado central: hay una diferencia significativa en la masa estimada por diferentes medios.

Para el caso particular del clúster coma, los primeros estudios que indicaron esta discrepancia entre las masas estimadas de diferentes formas fueron realizados por Fritz Zwicky en 1933. Más tarde, Vera Rubin estudió en detalle la curva de rotación de galaxias individuales, y luego de estudios muy exhaustivos para muchas galaxias, encontró una discrepancia entre la dependencia radial de la velocidad de rotación esperada y la observada, indicando nuevamente una discrepancia entre la masa esperada y la masa observada. Los trabajos de Vera Rubin pusieron en claro la existencia de un problema en cosmología que continúa abierto hasta nuestros días.

Si bien estos no son los únicos argumentos a favor de la existencia de materia oscura, en conjunto con otros resultados nos indican que cerca del 85% de la materia en el universo tiene que ser materia oscura. Y para el caso particular del cúmulo de Coma, estimaciones usando mediciones astronómicas y el teorema del virial indican que cerca del 90% de la materia en el cúmulo es materia oscura.

-

El dinero es un gas

En esta escena que mencioné ayer en clase de la película El lobo de Wall Street, dirigida por Martin Scorsese, Matthew McConaughey habla la “fugacidad” de la bolsa de valores. Llamativamente, la lírica de la canción “Money“, de Pink Floyd (del disco The Dark Side of the Moon, tiene la memorable frase “Money, it’s a gas“. Y ninguna de estas frases es simplemente una licencia poética. En muchos sentidos hay conexiones profundas entre la mecánica estadística y el modelado de los mercados bursátiles, que en algunos casos se remontan hasta los inicios de la teoría.

Los que tengan curiosidad sobre cómo se usan herramientas de mecánica estadística para el estudio de economía y finanzas pueden mirar este muy buen review:

que fue publicado en Reviews of Modern Physics en 2009. El artículo es introductorio y explica varios de los conceptos que se usan comúnmente en el área de econofísica, incluyendo modelos estocásticos (como los modelos de camino al azar que vimos en clase), cómo se usan el ensamble canónico y el gran canónico, los vínculos asociados a la “conservación del dinero”, o los vínculos que se usan en sistemas más realistas en los que pueden existir deudas y cómo esto resulta en diferentes equilibrios estadísticos. En particular, la Sección I, y la Sección II desde la subsección A hasta la C, se leen fácilmente y usan muchos de los conceptos que introdujimos hasta ahora en la materia.

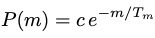

En las secciones II.B y II.C, los autores reemplazan el vínculo sobre la energía que usamos al derivar los ensambles, por un vínculo sobre el dinero total circulante. Si asumimos que el dinero total se conserva, la distribución de probabilidad de equilibrio para el dinero está dada por la distribución de Boltzmann-Gibbs,

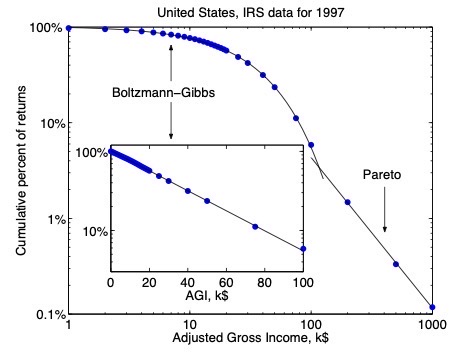

donde m es la cantidad de dinero, y Tm es la “temperatura estadística” del sistema (es decir, el multiplicador de Lagrange asociado al vínculo). Esta cantidad (Tm) es igual al dinero medio disponible por persona. Noten que esta expresión para la probabilidad es formalmente igual a la obtenida en el ensamble canónico. Excepto por casos con ingresos extremadamente grandes (que deben ser modelados con otra distrubución de probabilidad, la distribución de Pareto), la distribución de Boltzmann-Gibbs está en buen acuerdo con los datos de muchos países. A modo de ejemplo, el review compara este resultado con la probabilidad acumulada en función de los ingresos de los individuos usando datos de la oficina de impuestos de los Estados Unidos:

En esta figura los puntos azules son datos (porcentaje acumulado de casos en función de los ingresos brutos ajustados de cada contribuyente), y la linea negra de la izquierda corresponde a la distribución de Boltzmann-Gibbs (o la distribución canónica), seguida por la distribución de probabilidad de Pareto.

Este artículo tiene también un hallazgo interesante sobre la visión amplia que tenía Boltzmann de la física, que más de 100 años atrás vislumbró la aplicabilidad de la mecánica estadística tanto en física como en otras áreas muy diversas del conocimiento (una visión que se cumplió con creces). En 1905 Boltzmann, hablando sobre la generalización y formalización de la mecánica estadística realizada por Gibbs, escribió:

“Esto abre una perspectiva amplia, si no pensamos solamente en objetos mecánicos. Consideremos aplicar este método a la estadística de seres vivos, de la sociedad, en sociología, etc.”

Boltzmann tomó algunas ideas de estadística que ya se aplicaban en su época en el estudio de la sociedad para construir su teoría de los gases diluidos. Así que su propuesta de aplicar la incipiente mecánica estadística en estudios de la sociedad y en sociología podría resultar esperable. La famosa novela de ciencia ficción “Fundación“, de Isaac Asimov, también juega con la idea de aplicar la teoría de gases diluidos en las ciencias sociales para predecir el posible desarrollo de una sociedad. Y las aplicaciones actuales de la mecánica estadística en biología, economía y otras ciencias pueden resultar aún más sorprendentes que lo que imaginaron Boltzmann o Asimov.

-

La física de Feynman y Shrek

Como mencioné varias veces en el aula, en esta materia no vamos a demostrar ni a derivar la termodinámica. Esta materia es, en cierto sentido, una materia sobre jerarquías en la naturaleza. No siempre podemos derivar un comportamiento complejo como resultado directo de leyes fundamentales. Muchas, muchísimas veces, al trabajar con sistemas complejos o extensos, necesitamos hacer aproximaciones e introducir conceptos que (aunque tienen vínculos con las leyes fundamentales de la naturaleza) tienen sentido solo en forma aproximada (¡como el calor!). Justamente en este video Feynman dice (en el minuto 0:22): “For example, at one end we have the fundamental laws of physics. Then we invent other terms for concepts which are approximate, which have, we believe, their ultimate explanation in terms of the fundamental laws. For instance, ‘heat’. Heat is supposed to be the jiggling, and the word for a hot thing is just the word for a mass of atoms which are jiggling.” (“Por ejemplo, en un extremo tenemos las leyes fundamentales de la física. Luego inventamos otros términos para conceptos que son aproximados, que, creemos, tienen su explicación última en términos de las leyes fundamentales. Por ejemplo, el “calor”. Se supone que el calor es la vibración, y la palabra para algo caliente es solo la palabra que usamos para una masa de átomos que se sacuden.”).

Noten que Feynman no intenta convencernos de que hay una expresión formal y correcta para el calor en términos de leyes o magnitudes físicas fundamentales. Nos dice que el calor es un concepto aproximado para describir ciertos fenómenos en una escala macroscópica. Muchos conceptos en termodinámica son de este tipo: algunos podremos formalizarlos, para otros necesitaremos muchas aproximaciones. Y la descripción microscópica que estamos construyendo será compatible (por diseño y construcción) con la termodinámica, porque si la violase construiríamos otra teoría microscópica. El enfoque de esta materia nos puede ayudar a entender ciertos sistemas físicos de otra forma, pero no se confundan y piensen que porque una teoría se deriva con más cuentas y trabajo es necesariamente mejor. Porque es imposible unir las dos descripciones (la macroscópica y la microscópica) sin hacer muchas aproximaciones en el medio.

Sobre este punto, en el video Feynman dice algo muy interesante, y que va contra la concepción simplista de la física que imagina que entender un fenómeno se reduce siempre a reducirlo a las leyes o principios fundamentales que están detrás. En el video Feynman continúa hablando de sistemas cada vez mas complejos, y aproximaciones cada vez mayores. Y en el minuto 2:52 se pregunta: “Which end is nearer to the ultimate creator, if I may use a religious metaphor? Which end is nearer to God? Beauty and hope, or the fundamental laws? I think that the right way, of course, is to say that the whole structural interconnection of the thing is what we have to look at. […] And so I do not think either end is nearer to God. To stand at either end, and to walk off that end of the pier only, hoping that out in that direction is the complete understanding, is a mistake.” (“¿Qué extremo está más cerca del creador final, si puedo usar una metáfora religiosa? ¿Qué extremo está más cerca de Dios? ¿La belleza y la esperanza, o las leyes fundamentales? Creo que la respuesta correcta, por supuesto, es decir que lo que debemos mirar es la interconexión completa de las cosas. […] Y entonces no creo que ninguno de los dos extremos esté más cerca de Dios. Pararse en cualquier extremo y caminar solo por ese extremo del muelle, esperando que partiendo desde ese punto encontraremos el entendimiento completo, es un error.”).

En términos más contemporáneos, los sistemas físicos extensos son como los ogros. Y los ogros son como las cebollas. ¿Apestan? ¡No! ¿Te hacen llorar? ¡No! ¿Si los dejás al sol se vuelven marrones y les crecen pelitos blancos? ¡Tampoco! Las cebollas tienen capas. Los ogros tiene capas. Y los sistemas físicos extensos tienen capas, como los ogros y las cebollas.

Y como los ogros, los sistemas físicos extensos no pueden comprenderse si solo miramos las capas más externas, o si solo miramos las capas centrales.

Para los que quieran aprender más sobre la visión de Feynman sobre cómo se construyen las leyes físicas, el video que está arriba es un extracto de una serie de siete seminarios que Feynman dio en Cornell, con el título “The character of physical law“. Pueden encontrar los videos de sus seminarios online, y también fueron transcriptos a un libro.

-

La entropía de Shannon

“Este pensador observó que todos los libros, por diversos que sean, constan de elementos iguales: el espacio, el punto, la coma, las veintidós letras del alfabeto. También alegó un hecho que todos los viajeros han confirmado: No hay en la vasta Biblioteca, dos libros idénticos. De esas premisas incontrovertibles dedujo que la Biblioteca es total y que sus anaqueles registran todas las posibles combinaciones de los veintitantos símbolos ortográficos (número, aunque vastísimo, no infinito) o sea todo lo que es dable expresar: en todos los idiomas. Todo: la historia minuciosa del porvenir, las autobiografías de los arcángeles, el catálogo fiel de la Biblioteca, miles y miles de catálogos falsos, la demostración de la falacia de esos catálogos, la demostración de la falacia del catálogo verdadero, el evangelio gnóstico de Basilides, el comentario de ese evangelio, el comentario del comentario de ese evangelio, la relación verídica de tu muerte, la versión de cada libro a todas las lenguas, las interpolaciones de cada libro en todos los libros, el tratado que Beda pudo escribir (y no escribió) sobre la mitología de los sajones, los libros perdidos de Tácito.”

Jorge Luis Borges, La Biblioteca de Babel (1941).

¿De cuántas formas pueden reordenarse los veintitantos símbolos ortográficos de la Biblioteca de Babel? ¿De cuántas formas puede Christopher Nolan reordenar el argumento de sus películas para hacer una película nueva? ¿Y cuanta información quedará en la película más arrevesada que Christopher Nolan pueda dirigir? Como suele ocurrir, los Simpsons se preguntaron todo esto antes (¡pero no antes que Borges o que Claude Shannon!):

¿Cuál es la relación entre entropía e información? En 1949, ocho años después que Borges publicase La Biblioteca de Babel, Claude Shannon publicó un trabajo en el que introdujo su famoso concepto de entropía de la información,

S = – Σ pi log pi.

En ese trabajo, aunque presentó una serie de teoremas con motivaciones plausibles, Shannon acepta que su principal motivación para usar una definición de este tipo, y en particular la función logaritmo, tiene que ver con que es práctica para lidiar con magnitudes medidas que pueden variar en varios órdenes de magnitud, con que vuelve ciertas operaciones con números grandes más fáciles de manejar, y con resultados previos en mecánica estadística como las definiciones de entropía de Boltzmann y de Gibbs.

En clase vimos cómo esta definición se relaciona con nociones de desorden o de interteza, y que para sucesos equiprobables se reduce a S = log(N), donde N es el número de sucesos posibles. Pero ¿cómo se relaciona esto con la noción de información?

Llamativamente, Borges se adelantó en su Biblioteca de Babel a esta pregunta. En otra parte del cuento escribe:

“El número de símbolos ortográficos es veinticinco. Esa comprobación permitió, hace trescientos años, formular una teoría general de la Biblioteca y resolver satisfactoriamente el problema que ninguna conjetura había descifrado: la naturaleza informe y caótica de casi todos los libros. Uno, que mi padre vio en un hexágono del circuito quince noventa y cuatro, constaba de las letras MCV perversamente repetidas desde el renglón primero hasta el último. Otro (muy consultado en esta zona) es un mero laberinto de letras, pero la página penúltima dice «Oh tiempo tus pirámides».”

Imaginemos, como Borges, un conjunto de símbolos ortográficos formado por 22 letras del alfabeto, mas el punto, la coma y el espacio (que marcaremos como “_”):

ABCDEFGHIKLMNOPQRSTVYZ.,_

Pensemos ahora que tenemos diferentes “emisores” que transmiten un mensaje usando estos símbolos. Como en el video de Los Simpsons (en un tema que está íntimamente relacionado con el cuento de Borges y el concepto de entropía de Shannon), pensemos que tenemos monos encadenados a máquinas de escribir, y que pueden escribir al azar textos de 50 símbolos en cada mensaje:

- El primer mono (M1) aprieta la letra A todas las veces: “AAAAAAAAAAAAAAAAAAAAAAAAAAAAAAAAAAAAAAAA”.

- El segundo mono (M2) aprieta solo letras con equiprobabilidad, sin usar puntuación o espacios: “AYZTMOICPQERVILVVLMODNBEKSDEHGAHGALMKEYC”

- El tercer mono (M3) aprieta cualquiera de las 25 teclas con equiprobabilidad: “DH, EKHVOZ . EZVIASC B PIM,YICAK DELA.ALSFBZOQNY E”.

- El cuarto mono (M4) aprieta cualquier tecla con su probabilidad de uso en el español (por ejemplo, el espacio tiene una probabilidad de ocurrencia de ≈ 0.17, la letra “A” de ≈ 0.10, la “E” de ≈ 0.11, etc.): “EOS RILND . QNL PAE A ARDTEOS DCMAEE AMA”.

- El quinto mono (M5) tiene un vocabulario de 10 palabras, y usa las reglas de espaciado y puntuación del español. Su vocabulario es: CASA, PEPE, TUS, PESCA, EN, PIRAMIDES, DOS, OH, PARA y TIEMPO. Usando solo esas palabras al azar, y el punto, la coma y el espacio, escribe: “DOS PESCA. TUS CASA PEPE, OH TIEMPO TUS PIRAMIDES.”

¿Cuánta información hay en cada mensaje? Para contestar esto, preguntémonos para qué emisor es más difícil predecir la ocurrencia de la siguiente letra, si nos llegasen sus mensajes de a una letra por vez (por ejemplo, por un telégrafo). En el primer caso, una vez que reconocimos el patrón, es fácil saber que la siguiente letra será una A. Cada nueva A no agrega entonces más información que la que ya teníamos (¡ya sabíamos que nos llegaría una A!). Es fácil también ver que el caso más difícil para predecir la ocurrencia de una nueva letra corresponde al del mono M3. Por otro lado, el mensaje de M5 parece más complicado, pero luego de recibir las letras “PES”, sabemos que solo pueden estar seguidas por “CA”. La entropía de Shannon mide esta noción de información, basada en la idea de que cuanto más difícil sea predecir la siguiente letra, más información nos aporta conocerla. Calculemos la entropía de cada emisor:

- S1 = ln 1 = 0

- S2 = ln 22 ≈ 3.091

- S3 = ln 25 ≈ 3.219

- S4 = -Σ pi log pi ≈ 2.766

- La entropía S5 es más difícil de calcular, pero es menor a S4 y mayor a S1.

Hay otra forma interesante de pensar cuánta información genera el emisor, y es pensar cuánto podemos comprimir el mensaje que nos envía el emisor sin perder información. Para el primer mono nos alcanza con decir que envió 50 “A”. El mensaje de M5 lo podemos comprimir como “D PES. TU C PEP, O TI TU PIR.” (ya que “D” solo puede ser seguido por “OS”, “PES” por “CA”, “TU” por “S”, etc.). En el mensaje de M3 no podemos sacar nada sin perder información. Un teorema famoso de Shannon nos dice que (para mensajes muy largos) la cota máxima a cuánto podemos comprimir el mensaje de un emisor sin perder información está relacionada con su entropía.

Los que quieran saber más pueden leer el paper original de Shannon: